PaddlePaddle:在Serverless架构上十几行代码实现OCR能力

目录

飞桨(PaddlePaddle)以百度多年的深度学习技术研究和业务应用为基础,是中国首个自主研发、功能完备、 开源开放的产业级深度学习平台,集深度学习核心训练和推理框架、基础模型库、端到端开发套件和丰富的工具组件于一体。

飞桨深度学习框架采用基于编程逻辑的组网范式,对于普通开发者而言更容易上手,同时支持声明式和命令式编程,兼具开发的灵活性和高性能。另外飞桨不仅广泛兼容第三方开源框架训练的模型部署,并且为不同的场景的生产环境提供了完备的推理引擎,包括适用于高性能服务器及云端推理的原生推理库 Paddle Inference,面向分布式、流水线生产环境下自动上云、A/B测试等高阶功能的服务化推理框架 Paddle Serving,针对于移动端、物联网场景的轻量化推理引擎 Paddle Lite,以及在浏览器、小程序等环境下使用的前端推理引擎 Paddle.js。同时,透过与不同场景下的主流硬件高度适配优化及异构计算的支持, 飞桨的推理性能也领先绝大部分的主流实现。

安装飞桨

飞桨可以被认为是一个Python的依赖库,官方提供了pip,conda,源码编译等多种安装方法。以pip安装方法为例,飞桨提供了CPU和GPU两个版本安装方法:

CPU版本安装方法:

1

pip install paddlepaddle

GPU版本安装方法:

1

pip install paddlepaddle-gpu

实践:手写数字识别任务

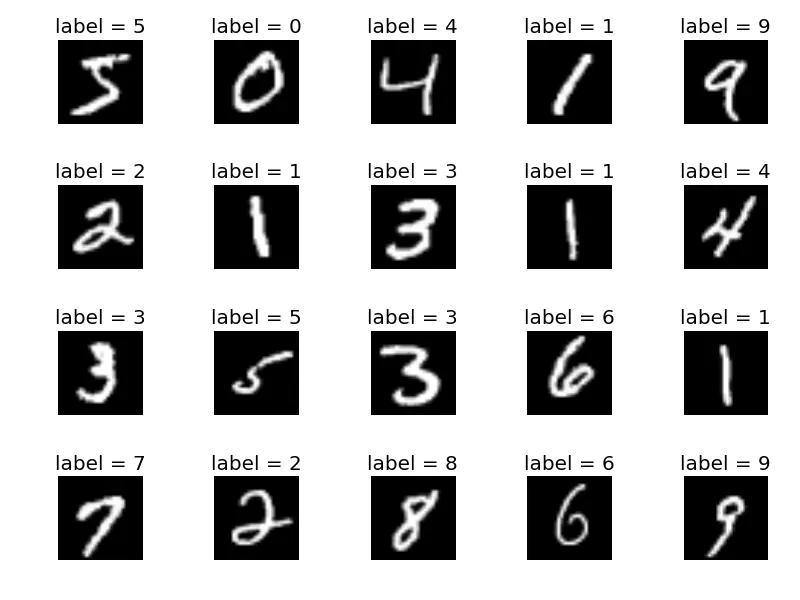

MNIST是非常有名的手写体数字识别数据集,在无论是Tensorflow的官方网站还是PaddlePaddle的新手入门,都是通过它做实战讲解,它由手写体数字的图片和相对应的标签组成,如:

MNIST数据集分为训练图像和测试图像。训练图像60000张,测试图像10000张,每一个图片代表0-9中的一个数字,且图片大小均为28*28的矩阵。这一小节将会以PaddlePaddle官方提供的MNIST手写数字识别任务为例,进行PaddlePaddle框架的基本学习。与其他深度学习任务一样,飞桨同样要通过以下四个步骤完成一个相对完整的深度学习任务:

- 数据集的准备和加载;

- 模型构建;

- 模型训练;

- 模型评估。

加载内置数据集

飞桨框架内置了一些常见的数据集,在这个示例中,开发者可以加载飞桨框架的内置数据集,例如本案例所涉及到的手写数字体数据集。这里加载两个数据集,一个用来训练模型,一个用来评估模型。

1 | import paddle.vision.transforms as T |

模型搭建

通过 Sequential 将一层一层的网络结构组建起来。注意,需要先对数据进行 Flatten 操作,将[1, 28, 28]形状的图片数据改变形状为[1, 784]。

1 | mnist = paddle.nn.Sequential( |

模型训练

在训练模型前,需要配置训练模型时损失的计算方法与优化方法,开发者可以使用飞桨框架提供的 prepare 完成,之后使用 fit 接口来开始训练模型。

1 | # 预计模型结构生成模型对象,便于进行后续的配置、训练和验证 |

训练结果:

1 | The loss value printed in the log is the current step, and the metric is the average value of previous steps. |

模型评估

开发者可以使用预先定义的验证数据集来评估前一步训练得到的模型的精度。

1 | model.evaluate(val_dataset, verbose=0) |

结果如下:

1 | {'loss': [2.145765e-06], 'acc': 0.9751} |

可以看出,初步训练得到的模型效果在97.5%附近,在逐渐了解飞桨后,开发者可以通过调整其中的训练参数来提升模型的精度。

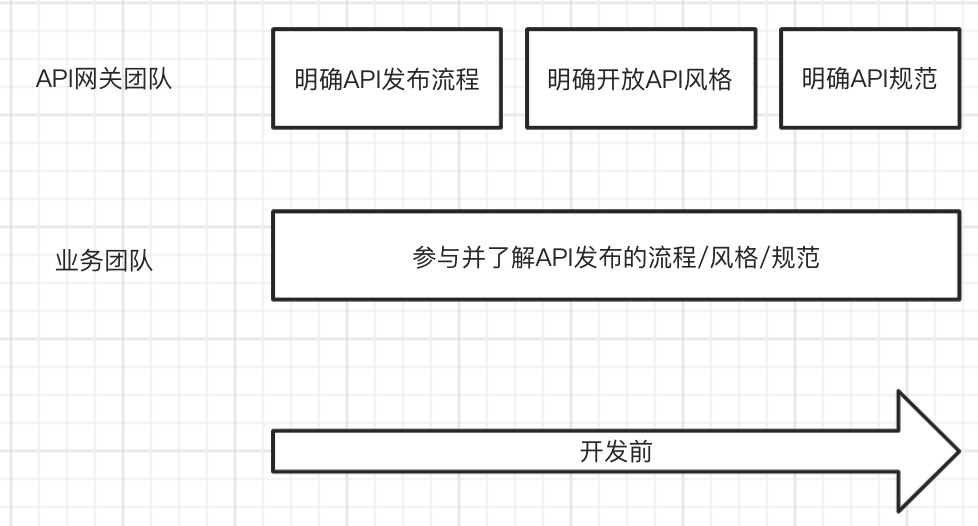

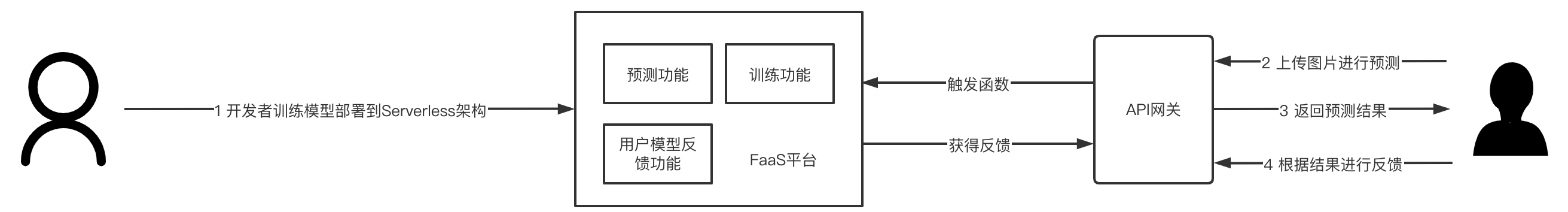

与Serverless架构结合

PaddlePaddle团队首次开源文字识别模型套件PaddleOCR,目标是打造丰富、领先、实用的文本识别模型/工具库。该模型套件是一个实用的超轻量OCR系统。主要由DB文本检测、检测框矫正和CRNN文本识别三部分组成。该系统从骨干网络选择和调整、预测头部的设计、数据增强、学习率变换策略、正则化参数选择、预训练模型使用以及模型自动裁剪量化8个方面,采用19个有效策略,对各个模块的模型进行效果调优和瘦身,最终得到整体大小为3.5M的超轻量中英文OCR和2.8M的英文数字OCR。

本地开发

根据PaddleOCR的项目案例,采用轻量级Python Web框架Bottle框架进行项目开发:

1 | # index.py |

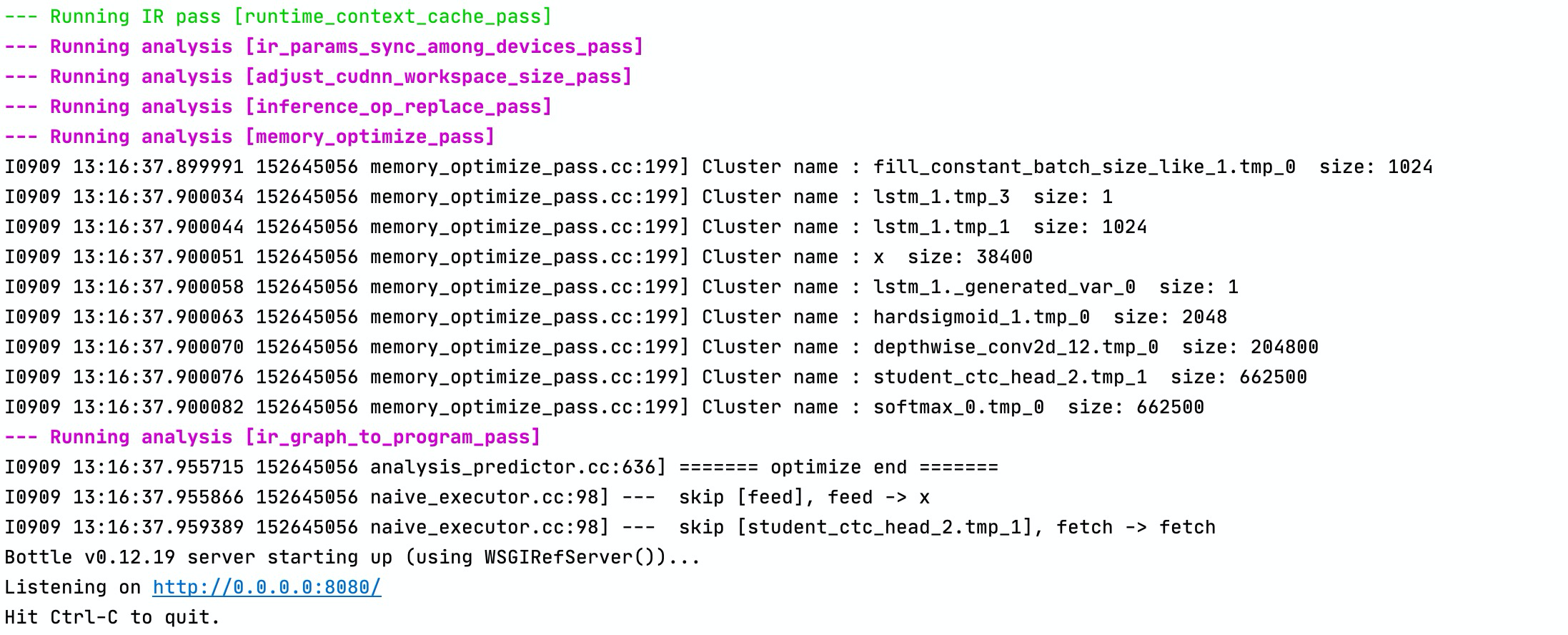

开发完成之后,运行该项目:

1 | python index.py |

可以看到服务已经启动:

然后通过Postman工具进行测试,首先准备一张图片(此处以PaddleOCR项目内置的测试图片为例):

通过将图片转换为Base64编码,并以POST方法请求刚刚启动的Web服务,可以看到PaddleOCR的执行结果:

部署到Serverless架构

目前各大云厂商的FaaS平台均已经逐渐支持容器镜像部署。所以,可以将项目打包成镜像,并通过Serverless Devs部署到阿里云函数计算。

部署前准备

首先需要完成Dockerfile文件:

1 | FROM python:3.7-slim |

编写符合Serverless Devs规范的Yaml文档:

1 | # s.yaml |

项目部署

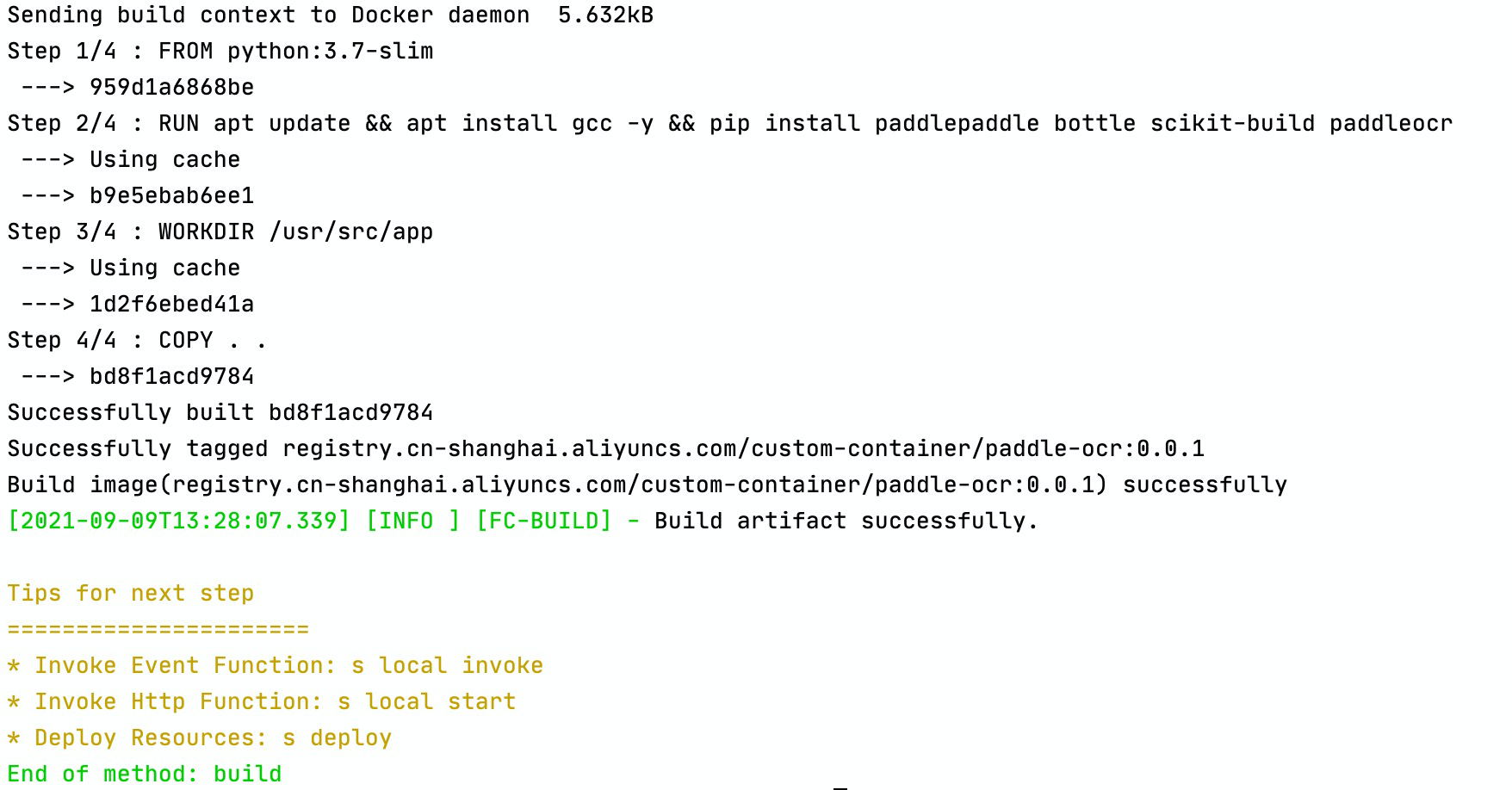

首先构建镜像,此处可以通过Serverless Devs进行构建:

1 | s build --use-docker |

构建完成之后,可以通过工具直接进行部署:

1 | s deploy --push-registry acr-internet --use-local -y |

部署完成,可以看到系统返回的测试地址:

项目测试

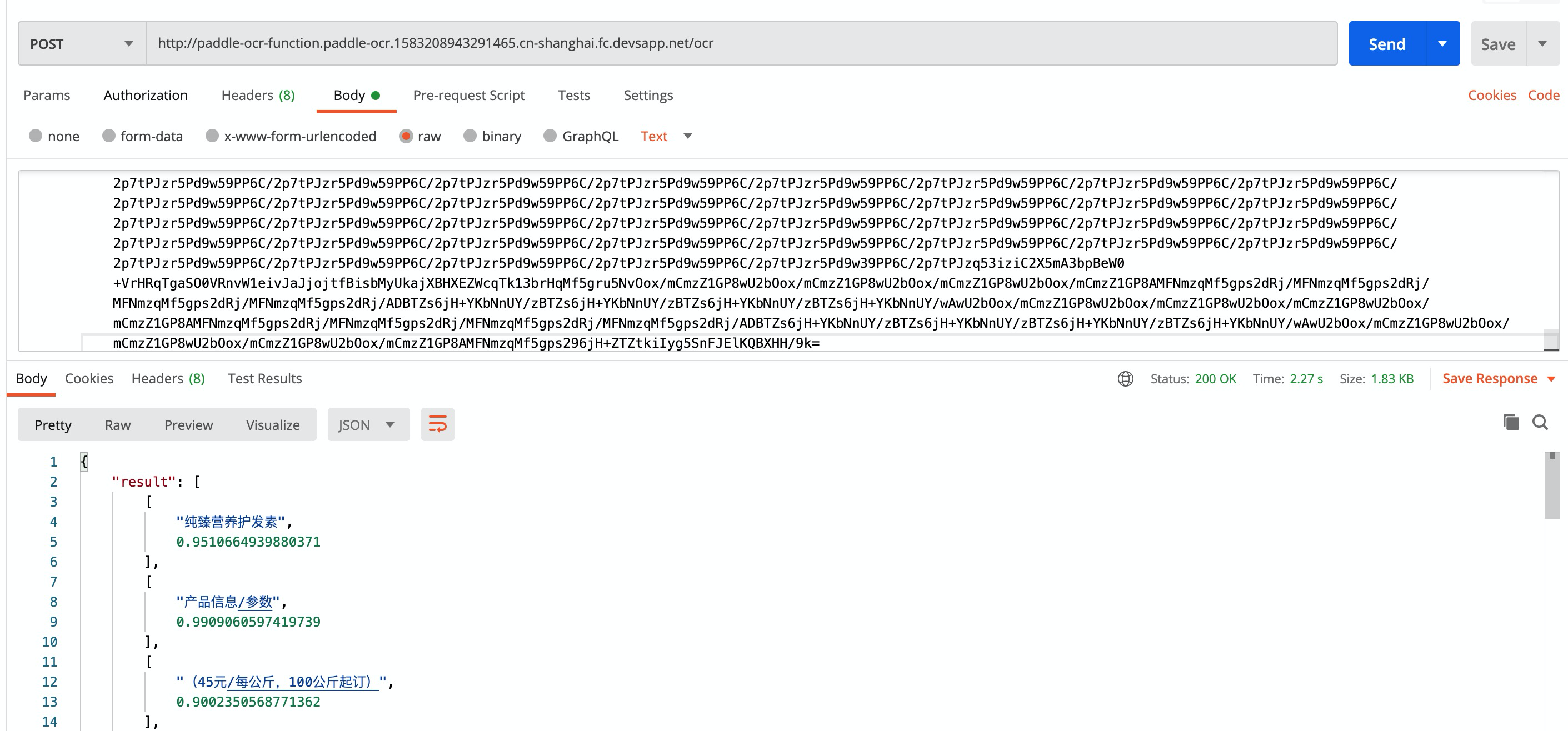

此时,可以通过该测试地址进行测试,同样得到了预期效果:

项目优化

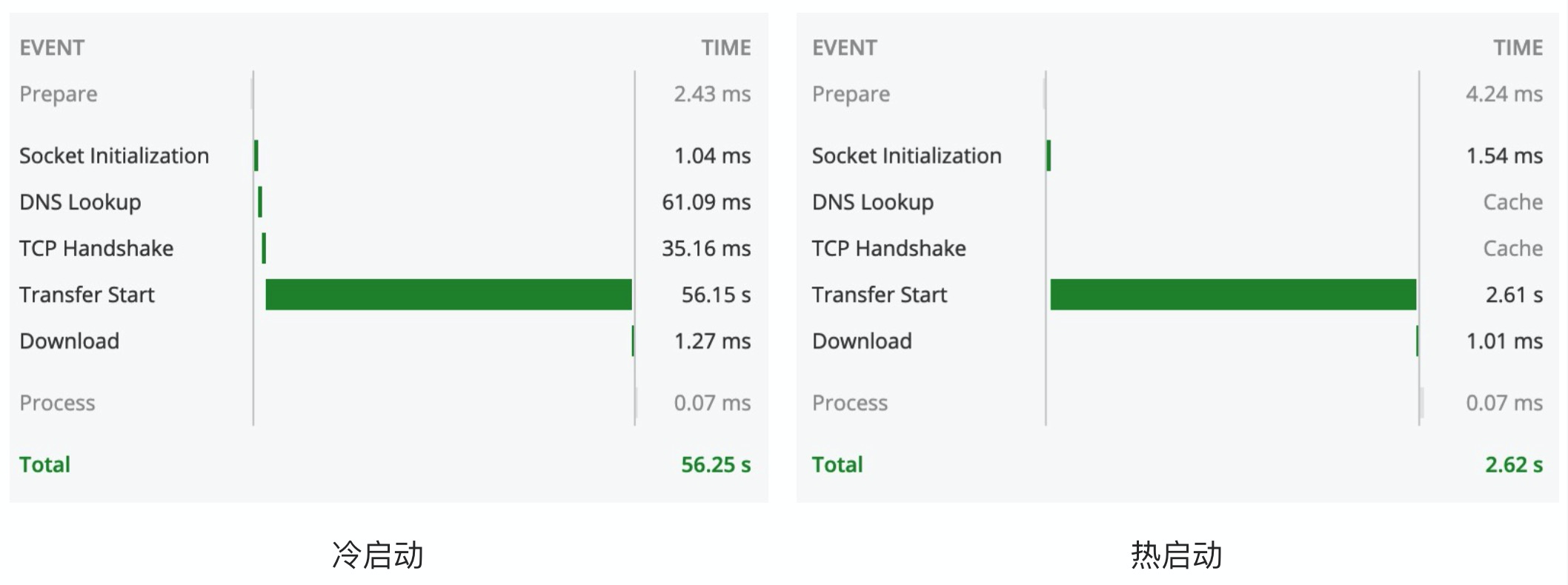

通过对部署在Serverless架构上的项目进行请求,可以看到冷启动和热启动的时间消耗:

通过冷启动与热启动的对比,我们可以发现,在热启动时,整个系统的性能是相对优秀的。但是遇到冷启动整个项目的响应时常是不可控的,此时可以考虑一下途径进行优化:

- 缩减容器镜像的体积,减少不必要的依赖、文件等,清理掉安装依赖时留下的缓存等;因为函数计算的冷启动包括镜像拉取时间;

- 部分流程进行优化,例如在PaddleOCR项目中有明确说明:“paddleocr会自动下载ppocr轻量级模型作为默认模型”,所以这就意味着该项目在Serverless架构的冷启动过程中,相对比热启动还增加了一个模型下载和解压的流程,所以这一部分在必要时是可以打入到容器镜像中,进而减少冷启动带来的影响;

- 开启镜像加速,可以有效降低容器镜像的冷启动,在阿里云函数计算官方文档中有相关镜像加速的性能测试描述:“开启函数计算的镜像加速后,可提速2~5倍,将分钟级的镜像拉取缩短至秒级”;

- 实例预留,最大程度上降低冷启动率。通过实例预留,可以通过多种算法/策略进行实例的预热和预启动,可以最大程度上降低Serverless架构冷启动带来的影响;

欢迎您关注我的博客,也欢迎转载该博客,转载请注明本文地址: http://bluo.cn/paddlepaddle-ocr/ 。有关于Serverless等相关问题欢迎联系我:80902630

|  |

| 微信号 | 抖音号 |